MCP (Model Context Protocol): Chuẩn kết nối AI với thế giới bên ngoài

MCP là viết tắt của Model Context Protocol - chuẩn mở do Anthropic giới thiệu năm 2024 để giải quyết bài toán lớn nhất của AI hiện đại: làm thế nào để một mô hình AI có thể kết nối với bất kỳ công cụ hay nguồn dữ liệu nào một cách nhất quán và an toàn? Nếu bạn đang xây dựng AI agent hoặc đơn giản muốn hiểu tại sao Claude có thể “đọc” GitHub hay Notion của bạn, bài này dành cho bạn.

Trước khi có MCP, mỗi AI application muốn kết nối với một công cụ bên ngoài - dù là Google Drive, database nội bộ hay một API bất kỳ - đều phải tự viết integration riêng. Cứ thêm một tool mới, lại thêm một đống code tùy chỉnh. Kết quả là hệ thống rời rạc, khó bảo trì và không thể tái sử dụng. MCP sinh ra để giải quyết đúng vấn đề đó: thay vì N x M kết nối tùy chỉnh, chỉ cần một chuẩn duy nhất cho tất cả.

MCP (Model Context Protocol) là gì?

MCP (Model Context Protocol) là một chuẩn giao tiếp mã nguồn mở, được Anthropic ra mắt vào tháng 11/2024. Mục đích của nó là chuẩn hóa cách các ứng dụng AI kết nối với các nguồn dữ liệu và công cụ bên ngoài.

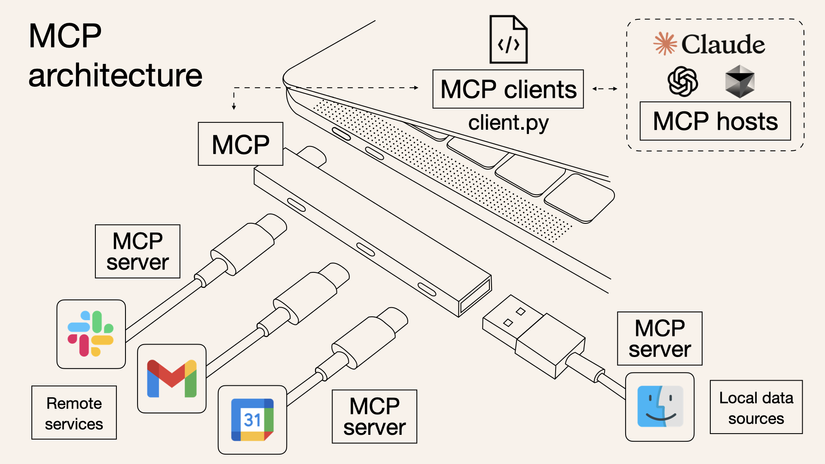

Cách dễ hiểu nhất: hãy nghĩ MCP như cổng USB-C dành cho AI. Trước khi có USB-C, mỗi thiết bị có một loại đầu cắm riêng - sạc laptop một kiểu, điện thoại một kiểu, tai nghe một kiểu. USB-C ra đời và mọi thứ dùng chung một chuẩn. MCP làm đúng điều đó cho AI: dù là Claude, ChatGPT hay bất kỳ model nào khác, đều có thể kết nối với bất kỳ tool nào miễn là tool đó hỗ trợ MCP.

Về mặt kỹ thuật, MCP sử dụng JSON-RPC 2.0 làm giao thức truyền tải - một chuẩn đã được kiểm chứng qua nhiều năm trong lập trình phân tán. Điều này đảm bảo tính tương thích cao và khả năng mở rộng tốt.

Tính đến đầu 2025, OpenAI đã tích hợp MCP vào Agents SDK và ChatGPT Desktop, Google DeepMind xác nhận Gemini sẽ hỗ trợ chuẩn này. Tháng 12/2025, Anthropic chuyển giao MCP cho Linux Foundation - một dấu hiệu rõ ràng rằng đây không còn là chuẩn của riêng một công ty, mà là nền tảng chung của cả ngành.

Kiến trúc MCP hoạt động như thế nào?

MCP theo mô hình client-server với 3 thành phần chính:

MCP Host

Là ứng dụng AI mà người dùng tương tác trực tiếp. Ví dụ điển hình: Claude Desktop, VS Code với Copilot, Cursor, Windsurf. Host chịu trách nhiệm khởi tạo và quản lý toàn bộ kết nối đến các MCP Server, đồng thời điều phối luồng thông tin giữa model AI và các tool bên ngoài.

MCP Client

Là một thành phần bên trong Host, chuyên quản lý kết nối đến một MCP Server cụ thể. Một Host có thể khởi tạo nhiều Client song song - mỗi Client kết nối đến một Server riêng biệt.

Ví dụ: VS Code đồng thời giữ kết nối với Filesystem Server, Database Server, và Sentry Server thông qua 3 Client độc lập. Khi AI cần đọc file, nó gọi qua Filesystem Client; khi cần tra lỗi production, nó gọi qua Sentry Client.

MCP Server

Là chương trình phơi bày dữ liệu và chức năng cho AI thông qua giao thức MCP chuẩn. Server có thể chạy theo hai cách:

- Local Server: Chạy trên cùng máy với Host, giao tiếp qua

stdio(standard input/output). Hiệu năng cao, không có network overhead. Ví dụ: Filesystem Server, SQLite Server. - Remote Server: Chạy trên internet, giao tiếp qua HTTP với Server-Sent Events. Hỗ trợ xác thực OAuth, API key. Ví dụ: Sentry MCP Server, GitHub MCP Server chính thức.

┌──────────────────────────────────────────┐

│ MCP Host (VS Code, Cursor...) │

│ ┌──────────┐ ┌──────────┐ ┌────────┐ │

│ │ Client 1 │ │ Client 2 │ │ Client │ │

│ └────┬─────┘ └────┬─────┘ └───┬────┘ │

└───────│─────────────│────────────│───────┘

│ │ │

┌────▼──────┐ ┌───▼──────┐ ┌─▼──────────┐

│ Filesys │ │ Database │ │ Sentry.io │

│ (local) │ │ (local) │ │ (remote) │

└───────────┘ └──────────┘ └────────────┘Ba “primitive” - Ngôn ngữ chung giữa AI và tool

Đây là phần quan trọng nhất để hiểu Model Context Protocol làm được gì. Mỗi MCP Server có thể cung cấp tối đa 3 loại “primitive” cho AI:

Tools - Hành động AI có thể thực hiện

Tools là các hàm mà AI có thể gọi để thực hiện một tác vụ cụ thể. Đây là primitive do model kiểm soát - AI tự quyết định khi nào cần gọi tool nào dựa trên ngữ cảnh cuộc trò chuyện, giống như một lập trình viên quyết định dùng hàm nào.

Ví dụ thực tế:

read_file- AI đọc nội dung một file từ filesystemquery_database- AI truy vấn cơ sở dữ liệu với câu SQLcreate_calendar_event- AI tạo sự kiện trực tiếp trên Google Calendarsearch_code- AI tìm kiếm đoạn code trong toàn bộ repository

Resources - Dữ liệu ngữ cảnh

Resources là các nguồn dữ liệu mà application cung cấp cho AI để làm ngữ cảnh nền. Khác với Tools (là hành động), Resources là thông tin tĩnh - ví dụ schema của database, nội dung tài liệu kỹ thuật, danh sách các công cụ có sẵn…

Prompts - Template tái sử dụng

Prompts là các template được định nghĩa sẵn do người dùng kiểm soát - user có thể gọi chúng khi cần. Ví dụ: một MCP Server cho code review có thể đi kèm sẵn prompt “Hãy review PR này theo tiêu chí bảo mật OWASP Top 10” để không cần nhập lại mỗi lần.

Tại sao MCP quan trọng - Lợi ích thực tế

-

Viết một lần, dùng khắp nơi: Một MCP Server cho GitHub hoạt động với Claude, ChatGPT, Cursor hay bất kỳ host nào hỗ trợ MCP - không cần viết integration riêng cho từng AI. Đây là lợi thế lớn nhất so với các cách tiếp cận trước đó.

-

Hệ sinh thái tool khổng lồ có sẵn: Hàng nghìn MCP Server đã được xây dựng bởi cộng đồng và các công ty lớn - từ Filesystem, GitHub, Slack, Notion, đến PostgreSQL và Kubernetes. Bạn không phải build từ đầu.

-

Bảo mật được chuẩn hóa: MCP có cơ chế xác thực rõ ràng ở tầng transport (OAuth, Bearer token, API key), thay vì mỗi integration tự xử lý theo cách riêng và dễ có lỗ hổng.

-

Nền tảng cho Agentic AI thực sự: Khi AI có access vào đúng tools qua MCP, nó không chỉ trả lời câu hỏi mà còn thực hiện hành động - đặt lịch, viết code, gửi email, cập nhật database. Đây là điều kiện cần để xây dựng Agentic AI thực sự tự chủ.

-

Developer tiết kiệm thời gian đáng kể: Thay vì mất hàng tuần code custom integration, bạn có thể tích hợp một MCP Server trong vài giờ với SDK có sẵn cho Python và TypeScript.

MCP trong thực tế - Use case nổi bật

Lập trình với AI: Cursor và VS Code Copilot dùng MCP để AI vừa đọc code, vừa tra cứu lỗi từ Sentry, vừa tạo PR trên GitHub - tất cả trong một workflow liền mạch không cần copy-paste qua lại.

Trợ lý cá nhân thực sự: Claude Desktop kết nối với Google Calendar và Notion qua MCP, trở thành trợ lý biết lịch thật của bạn và có thể tạo note vào đúng workspace. Đây là sự khác biệt giữa AI “biết về Notion” và AI “có thể làm việc trong Notion của bạn”.

Doanh nghiệp: Chatbot nội bộ kết nối đồng thời với nhiều database, hệ thống CRM và tài liệu nội bộ qua MCP - không cần viết connector riêng cho từng nguồn, bảo mật được kiểm soát tập trung.

Design sang Code: Claude Code đọc design từ Figma qua MCP và generate code React/CSS phù hợp trực tiếp - giảm thiểu bước “dịch” thủ công từ design spec sang implementation.

MCP vs các phương pháp truyền thống

| MCP | Custom Integration | RAG | |

|---|---|---|---|

| Khả năng thực hiện action | Có (Tools) | Có | Không |

| Chuẩn hóa | Cao | Thấp | Trung bình |

| Tái sử dụng cross-platform | Cao | Thấp | Trung bình |

| Dữ liệu real-time | Có | Có | Không |

| Độ phức tạp khi triển khai | Thấp (có SDK) | Cao | Trung bình |

| Bảo mật chuẩn hóa | Có | Tùy từng team | Không |

Context trong AI vẫn là nền tảng - MCP là cơ chế để đưa context đó vào AI từ các nguồn bên ngoài một cách có hệ thống và an toàn.

Câu hỏi thường gặp (FAQ)

MCP có phải do Anthropic độc quyền kiểm soát không?

Không. Dù Anthropic tạo ra Model Context Protocol vào tháng 11/2024, tháng 12/2025 họ đã chuyển giao cho Linux Foundation thông qua tổ chức Agentic AI Foundation (AAIF). MCP hiện là chuẩn mở độc lập, được cộng đồng và nhiều công ty lớn đồng quản trị - tương tự cách Linux hay Kubernetes được quản lý.

OpenAI và Google có hỗ trợ MCP không?

Có. OpenAI tích hợp MCP vào Agents SDK, Responses API và ChatGPT Desktop từ tháng 3/2025. Google DeepMind xác nhận hỗ trợ MCP trong Gemini từ tháng 4/2025. Điều này xác nhận MCP đang trở thành chuẩn công nghiệp thực sự - không phải chuẩn độc quyền của một hãng.

Làm thế nào để bắt đầu dùng MCP với Claude Desktop?

Claude Desktop hỗ trợ MCP sẵn. Bạn chỉ cần chỉnh file cấu hình claude_desktop_config.json để khai báo các MCP Server muốn kết nối. Anthropic và cộng đồng cung cấp sẵn server cho Filesystem, GitHub, Brave Search, PostgreSQL, Notion… Xem danh sách đầy đủ tại modelcontextprotocol.io/servers.

MCP khác gì với Function Calling / Tool Use thông thường?

Function Calling là tính năng của từng model cụ thể để gọi hàm được định nghĩa trong prompt. MCP là một tầng cao hơn và độc lập hơn: nó chuẩn hóa cách tool được phát hiện, kết nối và gọi từ bất kỳ model nào, thông qua một giao thức có lifecycle và multi-server management. MCP sử dụng Function Calling bên dưới, nhưng bổ sung thêm khả năng discovery tự động, quản lý kết nối và hỗ trợ nhiều server đồng thời.

Có cần biết code để dùng MCP không?

Để dùng các MCP Server có sẵn: không cần code nhiều, chủ yếu chỉnh file config JSON. Để tự viết một MCP Server mới: cần biết code cơ bản, Python và TypeScript là hai ngôn ngữ có SDK tốt nhất. Anthropic cung cấp documentation chi tiết kèm ví dụ thực tế tại modelcontextprotocol.io/docs.

Tổng kết

MCP là bước tiến quan trọng trong hành trình biến AI từ chatbot thụ động thành agent chủ động có thể kết nối và hành động trong thế giới thực. Với sự hỗ trợ từ OpenAI, Google, Microsoft và hàng nghìn developer trong cộng đồng, Model Context Protocol đang trên đà trở thành “ngôn ngữ chung” cho mọi AI tool integration. Nếu bạn đang xây dựng AI workflow hay muốn tối đa hóa năng lực của AI assistant, hiểu MCP là bước không thể bỏ qua.

Liên kết

- Context trong AI: Chìa khóa để biến AI từ 'người lạ' thành 'cộng sự

- Kỷ Nguyên Agentic AI: Từ Chatbot Đến AI Agent Tự Chủ Thực Thi

- Claude Agent và Skill là gì? Hướng dẫn cho người mới bắt đầu

- AI Engineering Framework: Model, Context, Skill và Prompt - 4 trụ cột của AI thực chiến

- Agentic Workflows in Enterprise: Từ trợ lý sanghHệ thống tự hành